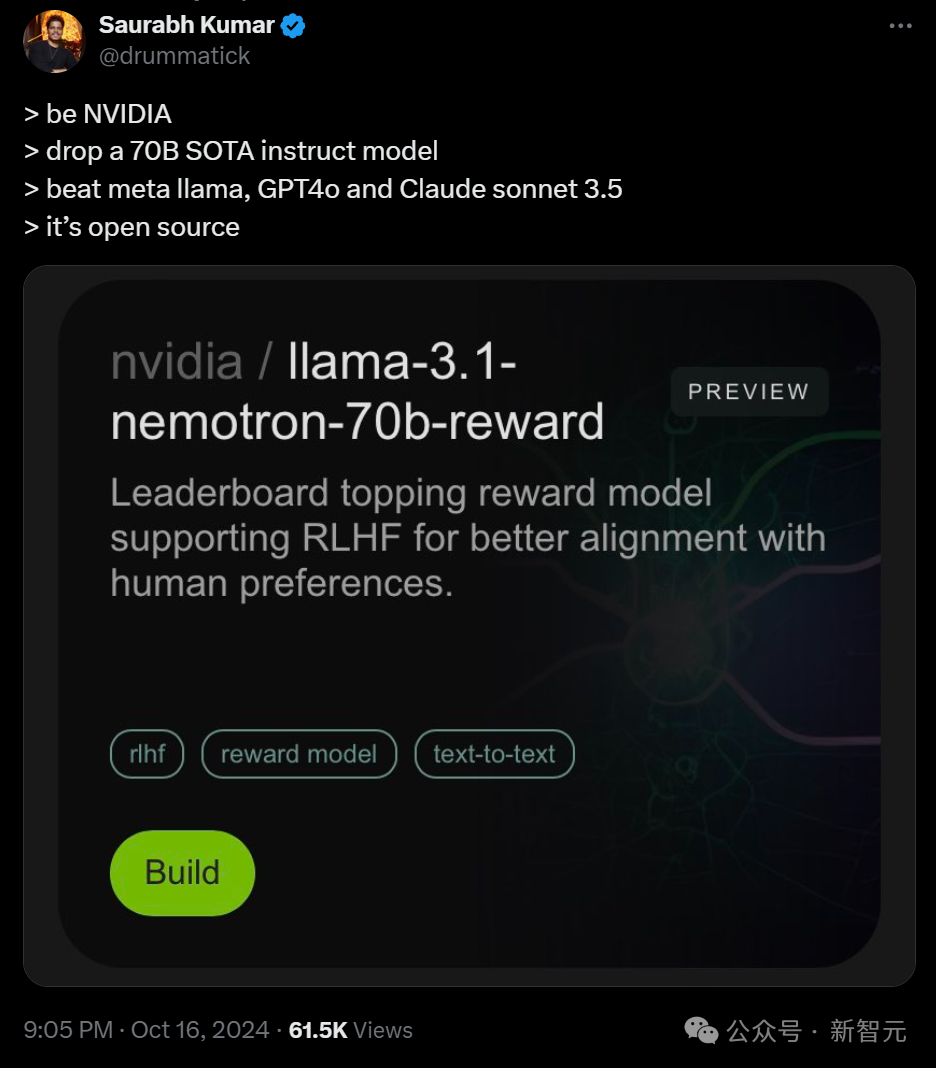

刚刚,英伟达开源了超强模子 Nemotron-70B,后者还是发布就卓越了 GPT-4o 和 Claude 3.5 Sonnet,仅次于 OpenAI o1!AI 社区惊呼:新的开源王者又来了?业内直呼:用 Llama 3.1 训出小模子吊打 GPT-4o,几乎是神来之笔!

一醒觉来,新模子 Nemotron-70B 成为仅次 o1 的最强王者!

是的,就在昨晚,英伟达悄无声气地开源了这个超坚决模子。还是发布,它坐窝在 AI 社区激发雄壮泛动。

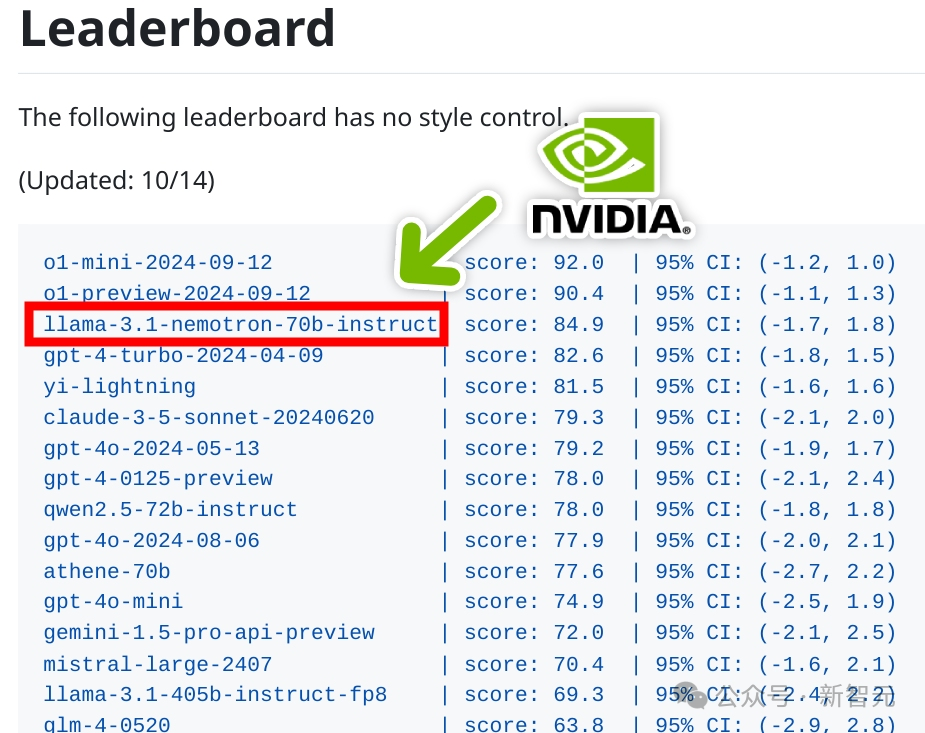

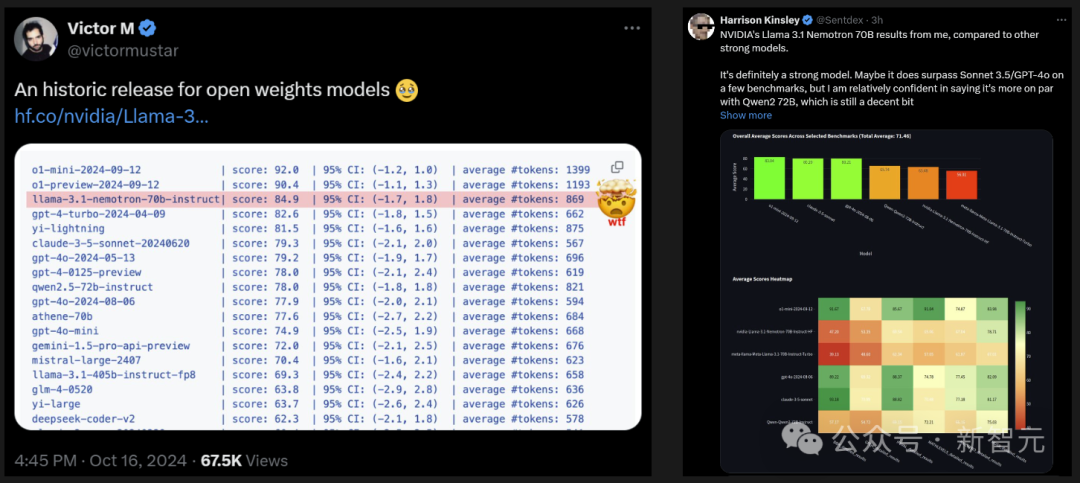

在多个基准测试中,它一举卓越多个起初进的 AI 模子,包括 OpenAI 的 GPT-4、GPT-4 Turbo 以及 Anthropic 的 Claude 3.5 Sonnet 等 140 多个开闭源模子。况兼仅次于 OpenAI 最新模子 o1。

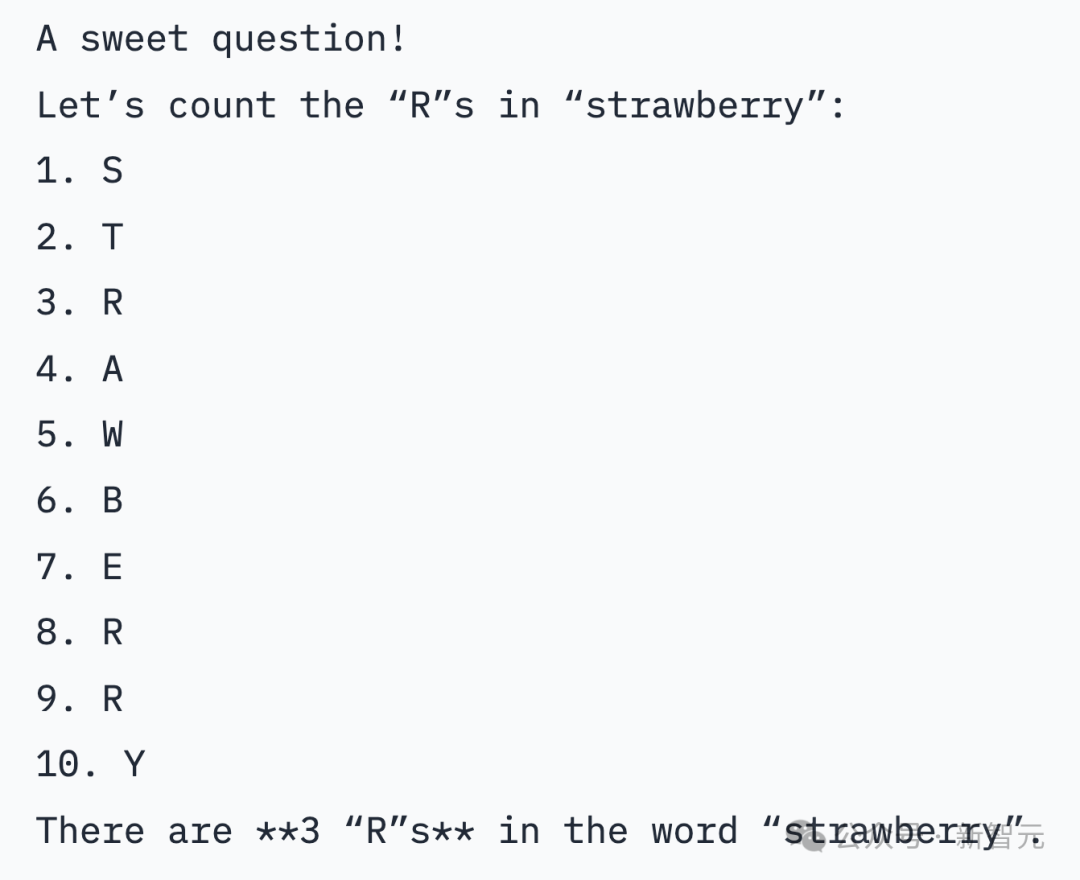

在即等于在莫得专诚辅导、特别推理 token 的情况下,Nemotron-70B 也能答对「草莓有几个 r」经典难题。

业内东说念主士评价:英伟达在 Llama 3.1 的基础上捕快出不太大的模子,卓越了 GPT-4o 和 Claude 3.5 Sonnet,几乎是神来之笔。

网友们纷繁辩驳:这是一个历史性的开放权重模子。

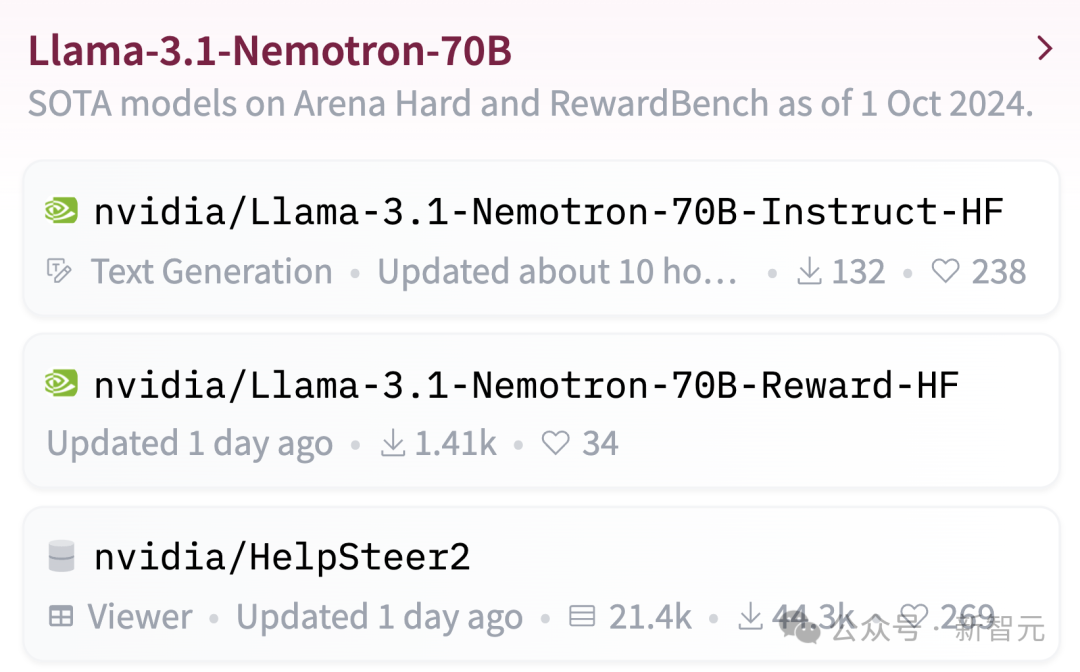

咫尺,模子权重已可在 Hugging Face 上获取。

地址:https://huggingface.co/ nvidia / Llama-3.1-Nemotron-70B-Instruct-HF

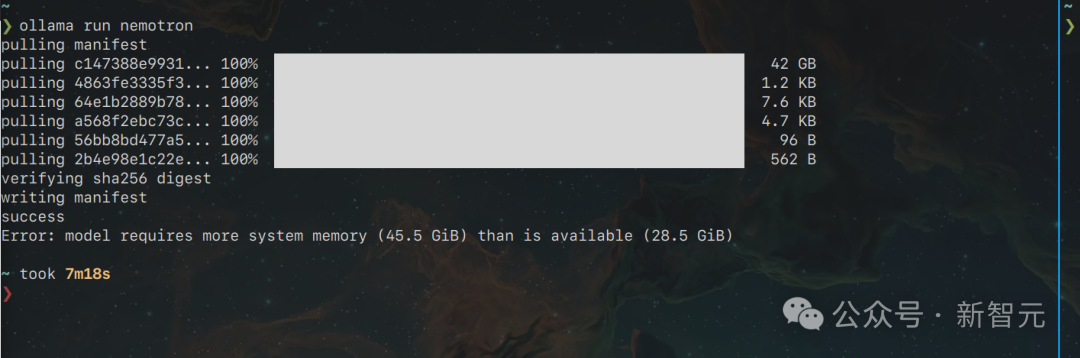

有东说念主已经用两台 Macbook 跑起来了。

卓越 GPT-4o,英伟达新模子爆火

Nemotron 基础模子,是基于 Llama-3.1-70B 拔擢而成。Nemotron-70B 通过东说念主类反馈强化学习完成的捕快,尤其是「强化算法」。

此次捕快历程中,使用了一种新的夹杂捕快要领,捕快奖励模子时用了 Bradley-Terry 和 Regression。使用夹杂捕快要领的要道,就是 Nemotron 的捕快数据集,而英伟达也一并开源了。

它基于 Llama-3.1-Nemotron-70B-Reward 提供奖励信号,并讹诈 HelpSteer2-Preference 辅导来指点模子生成适宜东说念主类偏好的谜底。

在英伟达团队一篇预印本论文中,专诚先容了 HelpSteer2-Preference 算法。

论文地址:https://arxiv.org/ pdf/2410.01257

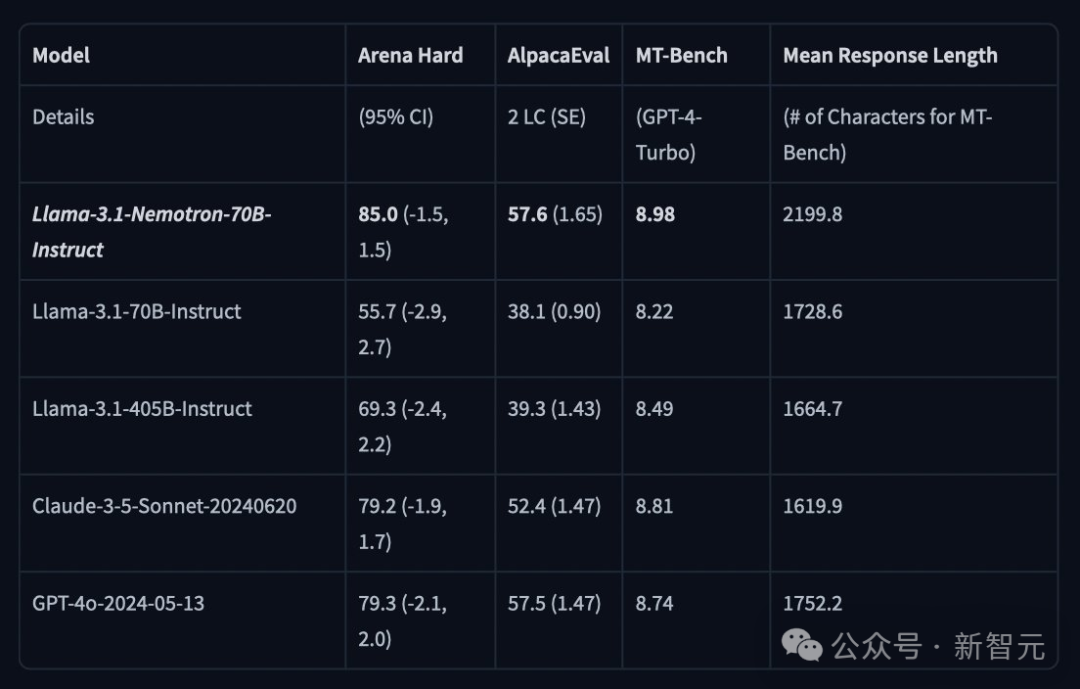

论文地址:https://arxiv.org/ pdf/2410.01257在 LMSYS 大模子竞技场中,Arena Hard 评测中,Nemotron-70B 得分 85。

在 AlpacaEval 2 LC 上得分 57.6,在 GPT-4-Turbo MT-Bench 上为 8.98。

冒昧打败 GPT-4o 的模子,究竟有多强?

各路网友纷繁出题,来练习 Nemotron-70B 真正水平。

测试动手!

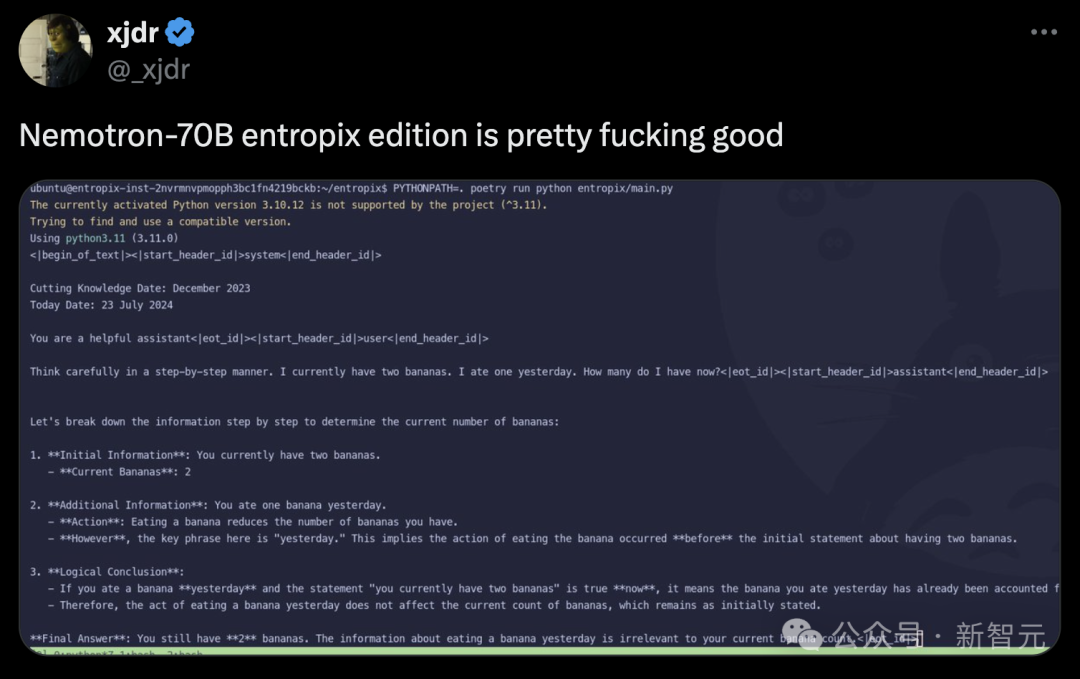

「一步一步隆重念念考:我咫尺有两根香蕉,我昨天吃掉一根,当今还有几根」?

Nemotron-70B 会将问题所给信息进行剖析,然后一步一步推理得出,最终的正确谜底是 2 根。

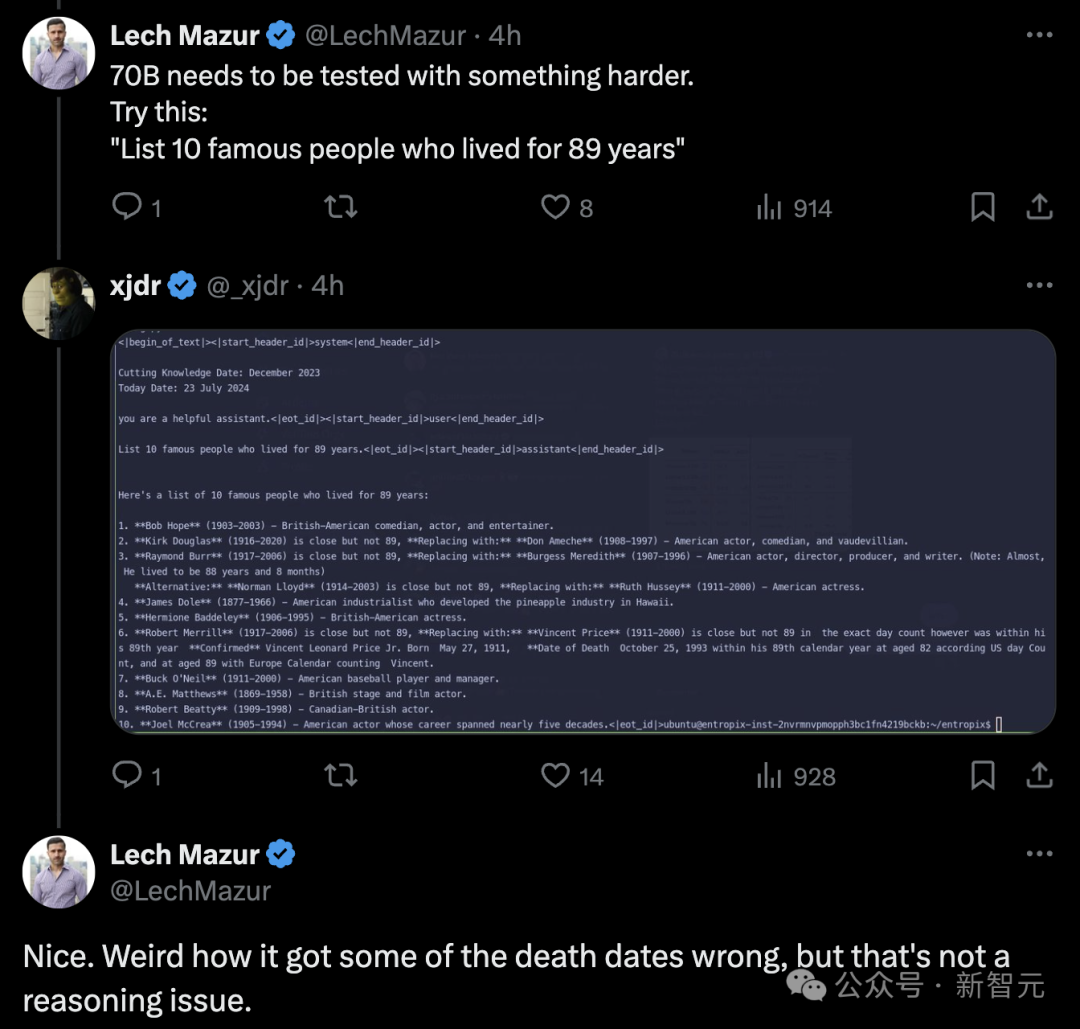

辩驳区网友暗意,来一说念上难度的题「列出活到 89 岁的十位名东说念主」。

不外,模子却把某东说念主的物化日历弄错了,然则它不是一个推理题。

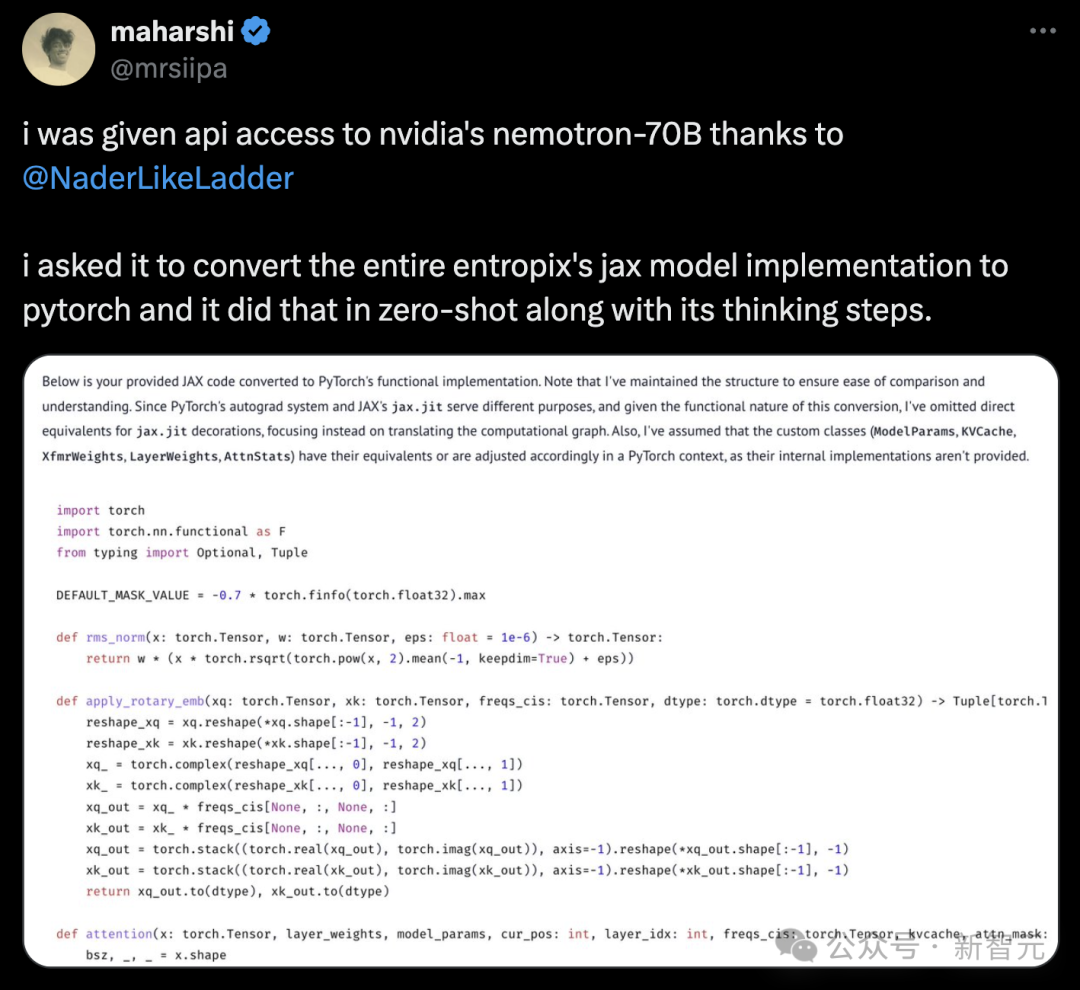

还有拔擢者要求它,将统共 entropix 的 jax 模子齐全调遣成 Pytorch 形式,而且在零样本的情况下,70B 模子就完成了。

那么,Nemotron-70B 在 hard prompt 上的阐扬,是否值得推敲?

在如下测试中,显著并莫得通过,但如实给出了一个很是趣味的初步输出。

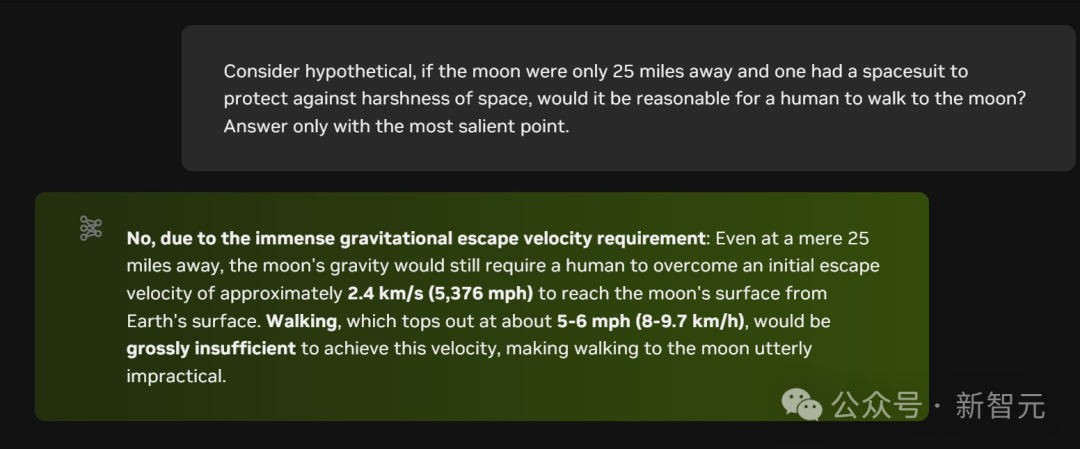

「探讨一个假定情况,若是月球惟一 25 英里远,而一个东说念主有天外服来保护我方免受天外环境的严酷影响,东说念主类走路到月球是否合理?只回答最杰出的重心。」

Nemotron-70B 给出的回答是:

弗成能,因为需要克服雄壮的重力逃跑速率:即使月球惟一 25 英里远,东说念主类仍然需要克服梗概 2.4 公里 / 秒(5,376 英里 / 小时)的运转逃跑速率,才能从地球名义到达月球名义。走路速率最快也惟一约 5-6 英里 / 小时(8-9.7 公里 / 小时),远远不及以达到这个速率,使得走路到月球统统不切骨子。

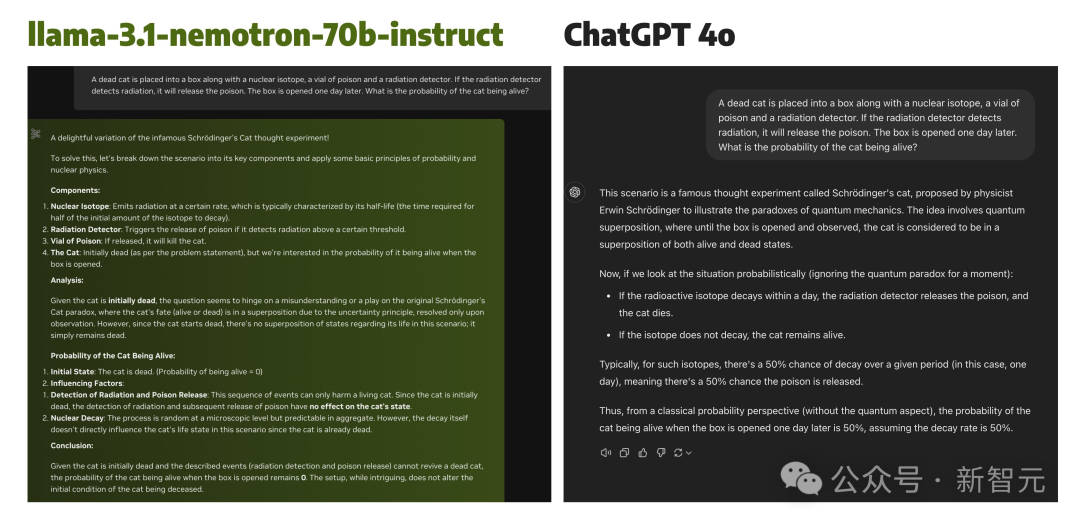

再来一说念推理题,让 Nemotron-70B 与 GPT-4o 通盘 PK「薛定谔的猫」推行变体:

一只死猫被放入一个盒子中,盒子里还有一个核同位素、一瓶毒药和一个发射探伤器。若是发射探伤器检测到发射,它就会开释毒药。一天后绽开盒子。猫辞世的概率是若干?

Nemotron-70B 探讨很有特质的是,从一动手就探讨到猫就是死的,即便放在盒子一天后,仍旧是死的。

而 GPT-4o 并没商酌注运转条目的进犯性,而是就盒子里的客不雅条目,进行分析得出 50% 的概率。

有网友暗意,很是期待看到 Nemotron 70B 在我方的 Ryzen 5 / Radeon 5600 Linux 电脑上跑起来是什么神气。

在 40GB + 以上的情况下,它几乎就是一头怪兽。

芯片巨头箝制开源超强模子

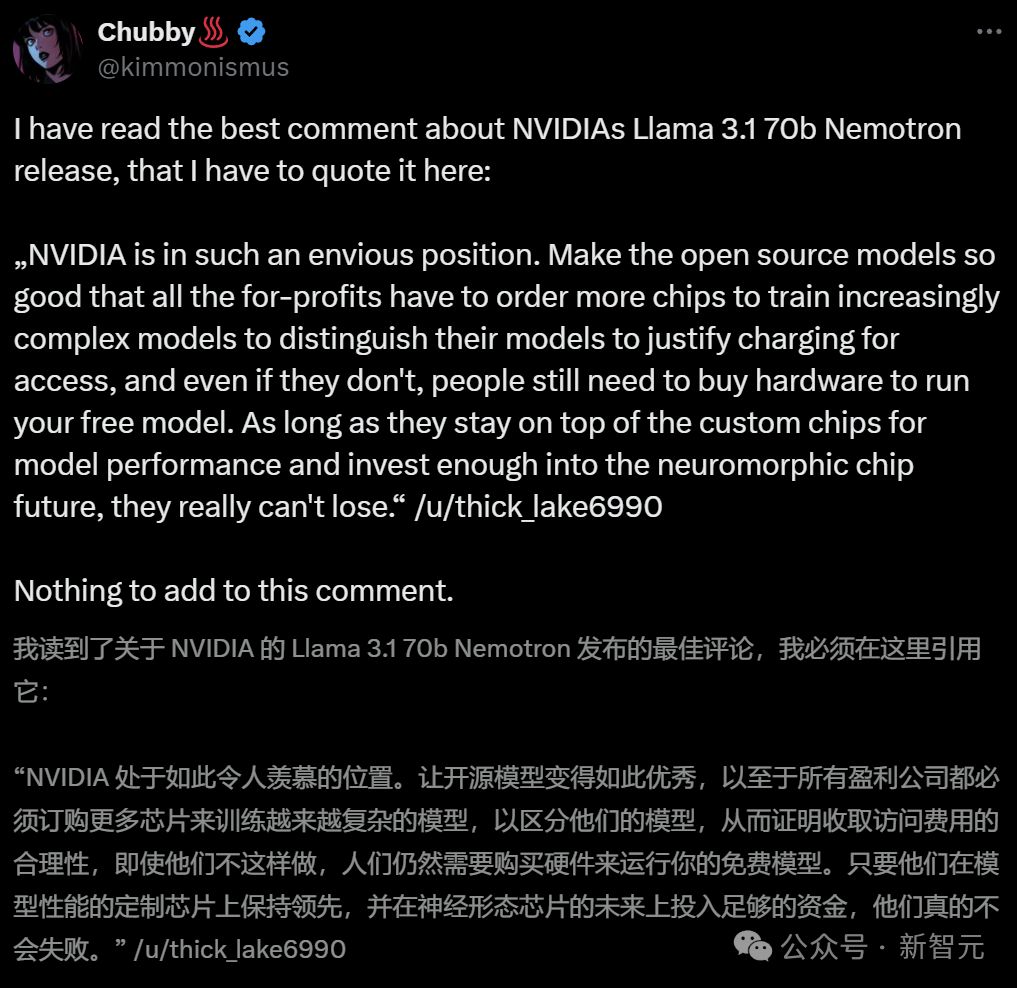

英伟达为若何此热衷于箝制开源超强模子?

业内东说念主暗意,之是以这样作念,就开源模子变得如斯优秀,就是为了让通盘盈利公司都必须订购更多芯片,来捕快越来越复杂的模子。岂论如何,东说念主们都需要购买硬件,来运行免费模子。

总之,只消英伟达在定制芯片上保抓开赴点,在神经形态芯片往时上干涉弥散资金,他们会耐久立于降龙伏虎。

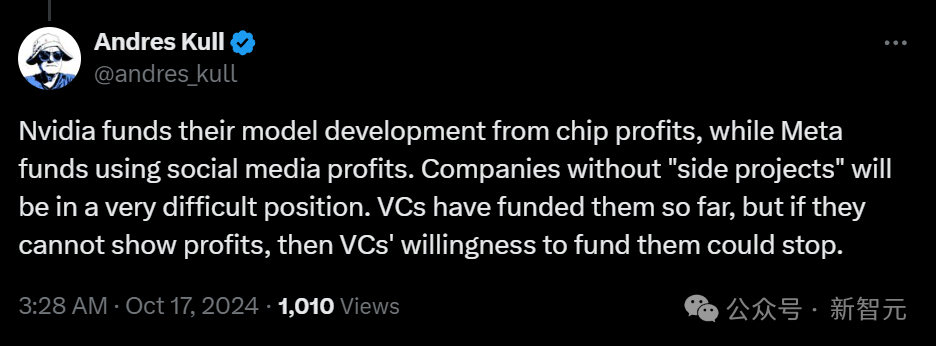

无代码初创公司首创东说念主 Andres Kull 心酸地暗意,英伟达不错箝制开源超强模子。因为他们既有大批资金资助操办者,同期还在箝制发展壮大拔擢生态。

而 Meta 不错依托我方的酬酢媒体,赢得利润上的资助。

然则大模子初创企业的处境就很是艰难了,巨头们通过种种妙技,在交易落地和名气上都取得了碾压,但小企业若是无法创造利润,将很快失去风头家的资助,赶快倒闭。

而愈加可怕的是,英伟达不错以低 1000 倍的本钱齐全这少许。

若是英伟达果真聘请这样作念,将无东说念主能与之匹敌。

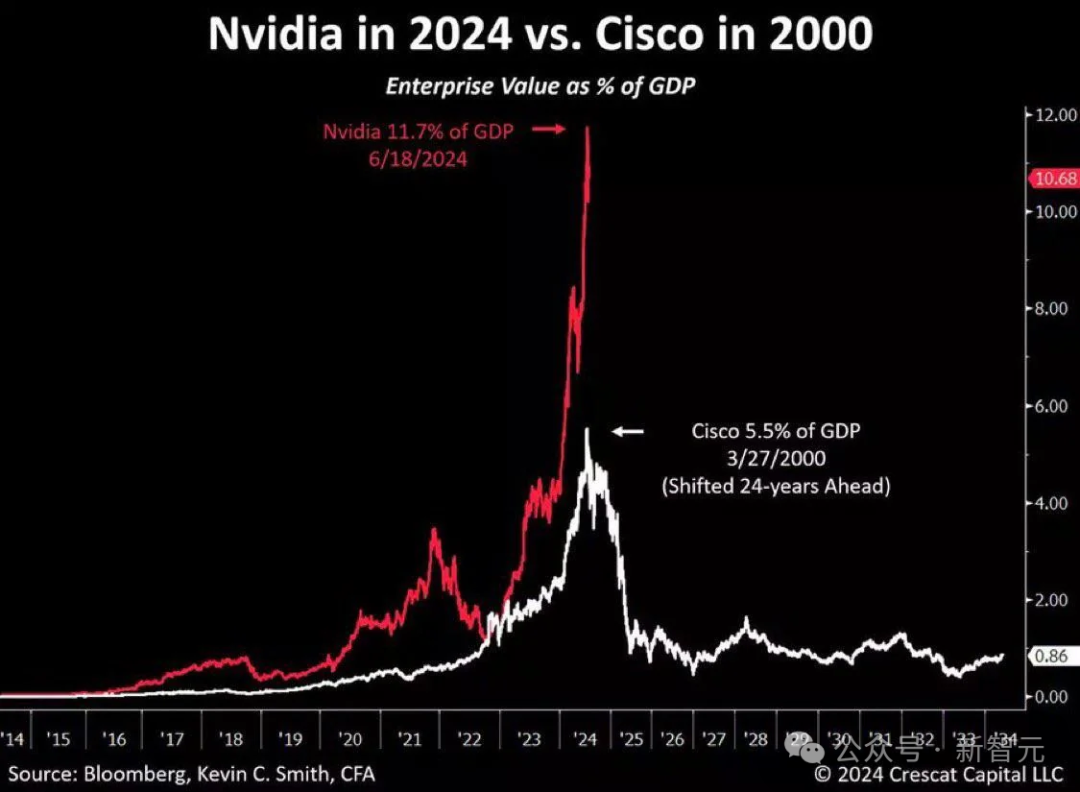

当今,英伟达占好意思国 GDP 的 11.7%。而在互联网泡沫顶峰期间,念念科仅占好意思国 GDP 的 5.5%

当今,英伟达占好意思国 GDP 的 11.7%。而在互联网泡沫顶峰期间,念念科仅占好意思国 GDP 的 5.5%最强开源模子是若何捕快出来的

在捕快模子的历程中,奖励模子证实了很进犯的作用,因为它关于调理模子的慑服指示才智至关进犯。

主流的奖励模子要领主要有两种:Bradley-Terry 和 Regression。

前者发祥于统计学中的排名表面,通过最大化被聘请和被拒却反应之间的奖励差距,为模子提供了一种径直的基于偏好的反馈。

后者则模仿了情愫学中的评重量表,通过展望特定辅导下反应的分数来捕快模子。这就允许模子对反应的质地进行更细节的评估。

对操办者和从业东说念主员来说,决定继承哪种奖励模子是很进犯的。

然则,缺少凭证标明,当数据充分匹配时,哪种要领优于另一种。这也就意味着,现存专派别据王人集无法提供充分匹配的数据。

英伟达操办者发现,迄今为止莫得东说念主公拔擢布过与这两种要领充分匹配的数据。

为此,他们王人集了两种模子的优点,发布了名为 HelpSteer2-Preference 的高质地数据集。

这样,Bradley-Terry 模子不错使用此类偏好隆重进行有用捕快,还不错让隆重者标明为什么更心爱一种反应而非另一种,从而操办和讹诈偏好事理。

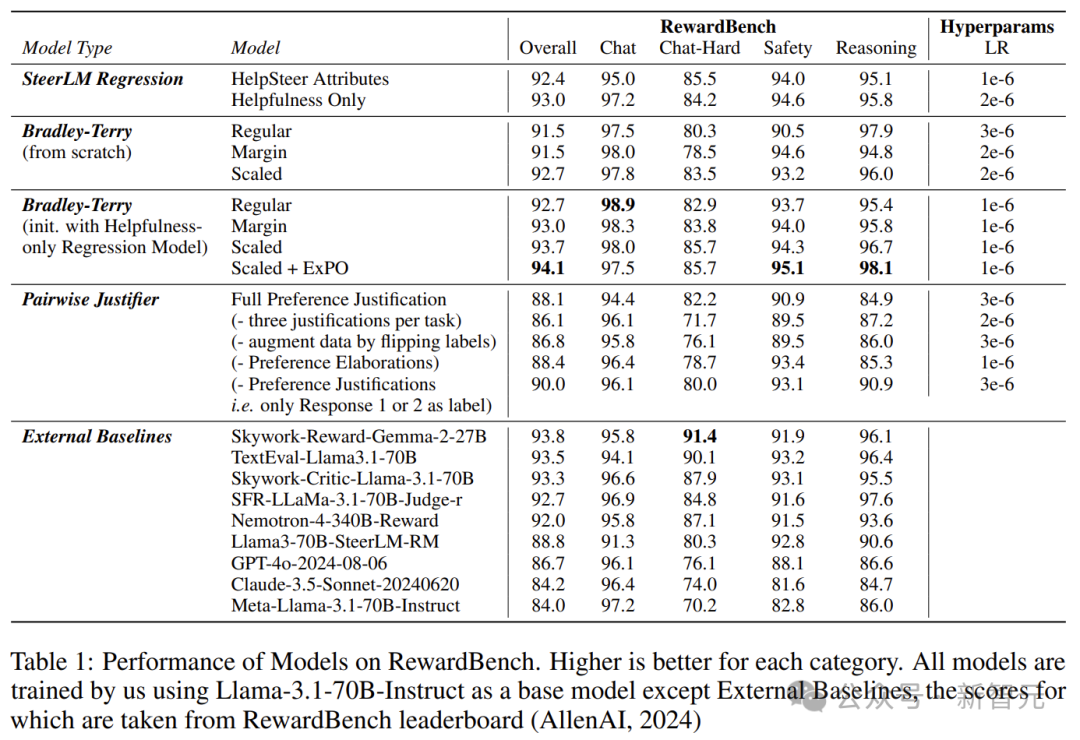

他们发现,这个数据王人集果极好,捕快出的模子性能极强,训出了 RewardBench 上的一些顶级模子(如 Nemotron-340B-Reward)。

主要孝顺不错总结为以下三点 ——

1. 开源了一个高质地的偏好建模数据集,这应该是包含东说念主类编写偏好事理的通用限制偏好数据集的第一个开源版块。

2. 讹诈这些数据,对 Bradley-Terry 作风和 Regression 作风的奖励模子,以及不错讹诈偏好事理的模子进行了比拟。

3. 得出了麇集 Bradley-Terry 和回首奖励模子的新颖要领,捕快出的奖励模子在 RewardBench 上得分为 94.1 分,这是截止 2024.10.1 阐扬最好的模子。

HelpSteer2-Preference 数据集

数据蚁集历程中,隆重者都会赢得一个辅导和两个反应。

他们开赴点在 Likert-5 量表上,从(有用性、正确性、连贯性、复杂性和冗长性)几个维度上,对每个反应进行隆重。

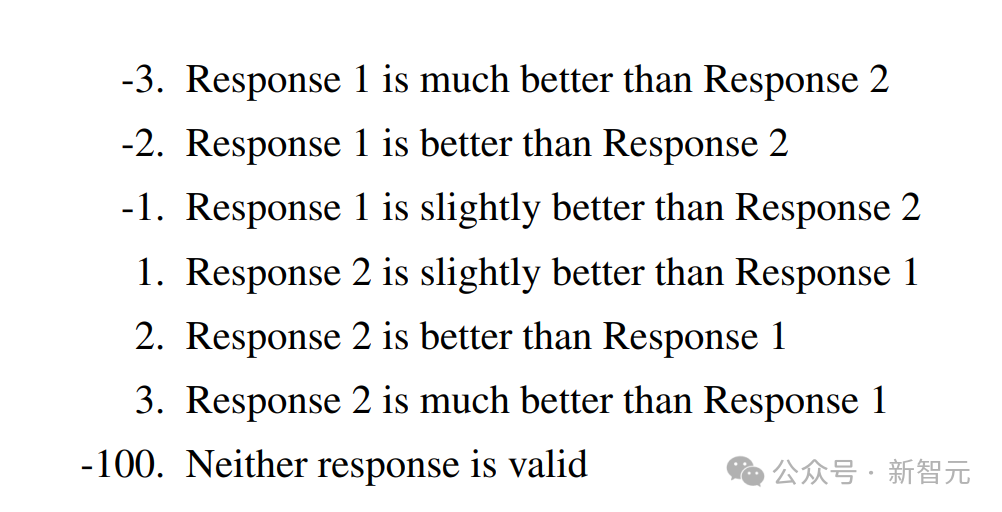

然后在 7 个偏好选项中进行聘请,每个选项都与一个偏好分数及偏好事理关系联。

Scale AI 会将每个任务分拨给 3-5 个隆重者,以孤立标志每个辅导的两个反应之间的偏好。

严格的数据预贬责,也保证了数据的质地。

根据 HelpSteer2,操办者会详情每个任务的三个最相同的偏好隆重,取其平均值,并将其四舍五入到最接近的整数,以给出全体偏好。

此外,操办者过滤掉了 10% 的任务,其中三个最相同的隆重散布逾越 2。

这样就幸免了对东说念主类隆重者无法自信评估真正偏好的任务进行捕快。

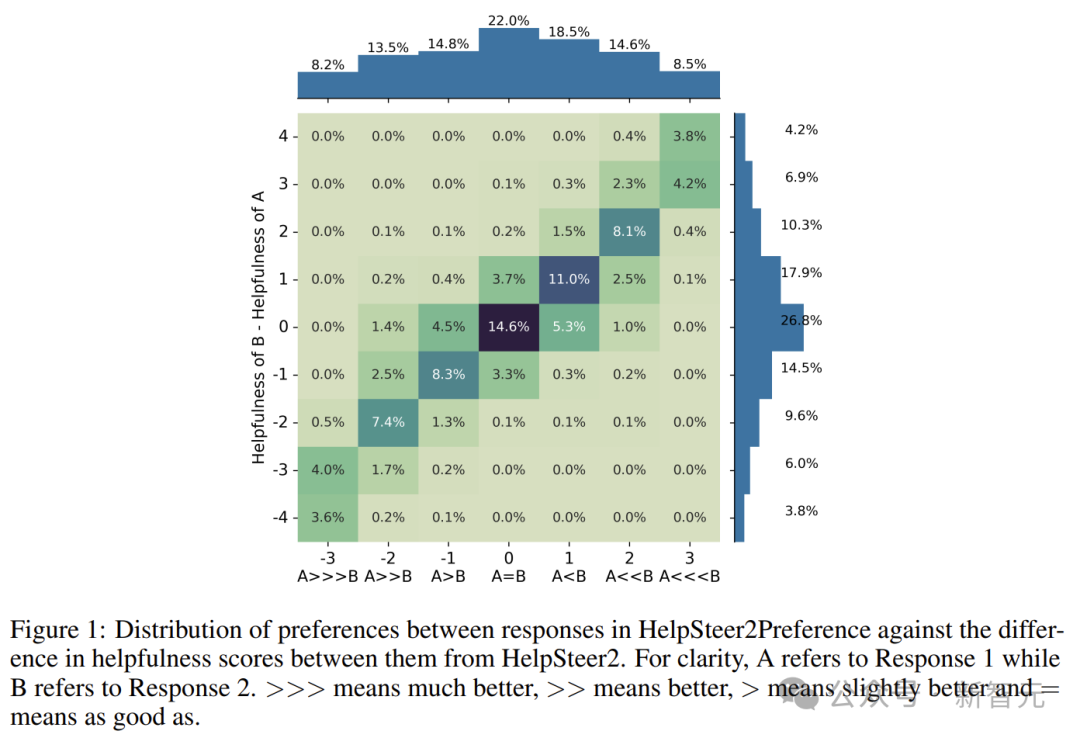

HelpSteer2Preference 中不同复兴之间的偏好散布与 HelpSteer 2 中它们的匡助评分互异之间的关系

HelpSteer2Preference 中不同复兴之间的偏好散布与 HelpSteer 2 中它们的匡助评分互异之间的关系操办者发现,当使用每种奖励模子的最好形势时,Bradley-Terry 类型和回首类型的奖励模子互相竞争。

此外,它们不错相反相成,捕快一个以仅限匡助性 SteerLM 回首模子为基础进交运转移的缩放 Bradley-Terry 模子,在 RewardBench 上全体得分达到 94.1。

遗弃 2024 年 10 月 1 日,这在 RewardBench 排名榜上排名第一。

RewardBench 上的模子阐扬

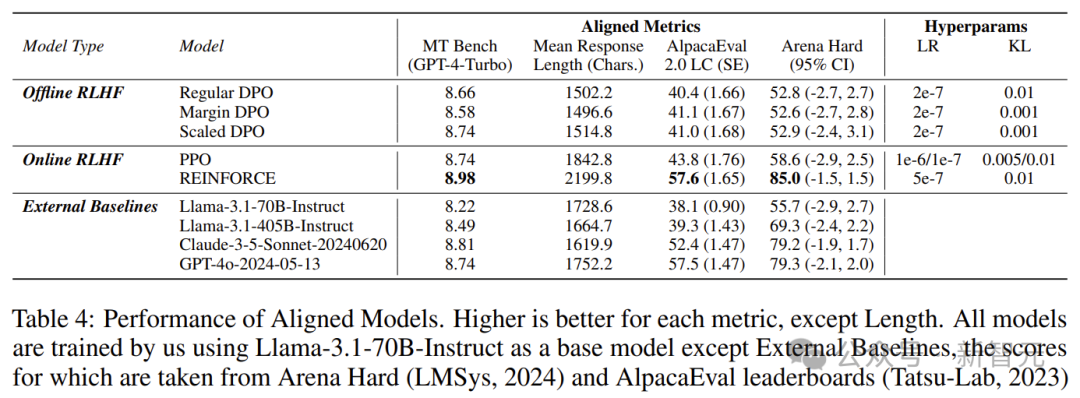

RewardBench 上的模子阐扬终末,这种奖励模子被解释在使用 Online RLHF(很是是 REINFORCE 算法)对王人模子以使其慑服指示方面,很是有用。

如表 4 所示,大多数算法关于 Llama-3.1-70B-Instruct 都有所校正。

对王人模子的性能:通盘模子均由 Llama-3.1-70B-Instruct 行为基础模子进行捕快

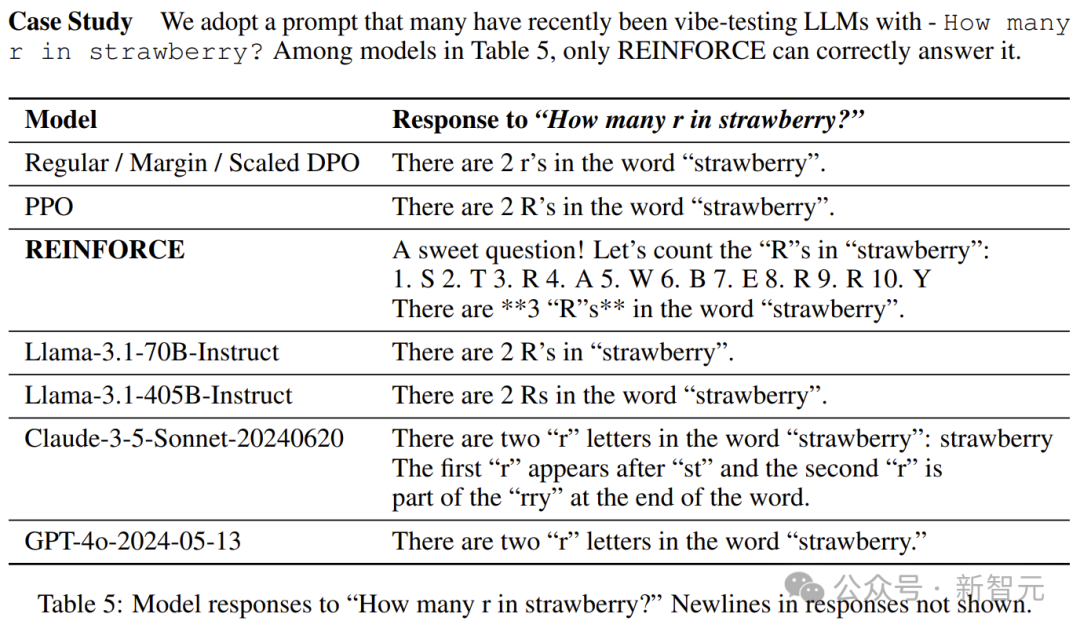

对王人模子的性能:通盘模子均由 Llama-3.1-70B-Instruct 行为基础模子进行捕快如表 5 所示,关于「Strawberry 中有几个 r」这个问题,惟一 REINFORCE 能正确回答这个问题。

参考贵寓:

https://arxiv.org/pdf/2410.01257

https://huggingface.co/nvidia/Llama-3.1-Nemotron-70B-Instruct-HF

告白声明:文内含有的对外跳转联贯(包括不限于超联贯、二维码、口令等形势),用于传递更多信息,狂放甄选技术,收尾仅供参考,IT之家通盘著述均包含本声明。

声明:新浪网独家稿件,未经授权不容转载。 -->